گوگل فناوری جدیدی به نام CALM را معرفی کرد که مدلهای زبان بزرگ (مانند GPT-3 و LaMDA) را بدون به خطر انداختن سطح عملکرد سرعت میبخشد.

داده های آموزشی بزرگتر بهتر است اما هزینه دارد

مدلهای زبان بزرگ (LLM) بر روی مقادیر زیادی داده آموزش میدهند.

آموزش مدلهای زبان بر روی مقادیر بیشتر داده منجر به یادگیری تواناییهای جدیدی در مدل میشود که همیشه برای آنها برنامهریزی نشده است.

به ،وان مثال، افزودن دادههای آموزشی بیشتر به یک مدل زبان میتواند به طور غیرمنتظرهای منجر به ،ب توانایی ترجمه بین زبانهای مختلف شود، حتی اگر برای انجام این کار آموزش ندیده باشد.

این تواناییهای جدید، تواناییهای نوظهور نامیده میشوند، تواناییهایی که ،وماً برای آنها برنامهریزی نشدهاند.

یک مقاله تحقیقاتی متفاوت (PDF) در مورد توانایی های اضطراری بیان می کند:

اگرچه دهها نمونه از تواناییهای نوظهور وجود دارد، اما در حال حاضر توضیحات قانعکنندهای برای اینکه چرا چنین تواناییهایی به شیوهای که پیدا میشوند، وجود دارد.

آنها نمی توانند توضیح دهند که چرا توانایی های مختلف آموخته می شوند.

اما به خوبی شناخته شده است که افزایش حجم داده برای آموزش ماشین به آن اجازه می دهد تا توانایی های بیشتری به دست آورد.

نقطه ضعف افزایش مقیاس داده های آموزشی این است که برای تولید ،وجی نیاز به توان مح،اتی بیشتری دارد، که باعث می شود هوش مصنوعی در زمان تولید ،وجی متن کندتر شود (لحظه ای که به آن “زمان استنتاج” می گویند).

بنابراین معامله با هوشمندتر ، هوش مصنوعی با داده های بیشتر این است که هوش مصنوعی در زمان استنتاج نیز کندتر می شود.

مقاله تحقیقاتی جدید گوگل (مدلسازی زبان تطبیقی مطمئن PDF) مشکل را اینگونه توضیح می دهد:

پیشرفتهای اخیر در مدلهای زبان بزرگ مبتنی بر Transformer (LLM) منجر به بهبود عملکرد قابل توجهی در بسیاری از وظایف شده است.

این دستاوردها با افزایش شدید اندازه مدلها همراه است که به طور بالقوه منجر به استفاده آهسته و پرهزینه در زمان استنتاج میشود.»

مدلسازی زبان تطبیقی مطمئن (CALM)

محققان در گوگل به راه حل جالبی برای سرعت بخشیدن به مدل های زبان و همچنین حفظ عملکرد بالا دست یافتند.

راه حل، برای قیاس، تا حدودی مانند تفاوت بین پاسخ دادن به یک سوال آسان و حل یک سوال دشوارتر است.

یک سوال آسان مانند رنگ آسمان را می توان با کمی فکر پاسخ داد.

اما یک پاسخ سخت مست،م توقف و تفکر برای یافتن پاسخ است.

از نظر مح،اتی، مدلهای زبان بزرگ تفاوتی بین بخش سخت یک کار تولید متن و بخش آسان قائل نمیشوند.

آنها متن را برای هر دو بخش آسان و دشوار با استفاده از قدرت مح،اتی کامل خود در زمان استنتاج تولید می کنند.

راه حل گوگل مدلسازی زبان تطبیقی مطمئن (CALM) نام دارد.

کاری که این چارچوب جدید انجام میدهد این است که منابع کمتری را به بخشهای بیاهمیت یک کار تولید متن اختصاص میدهد و تمام قدرت را برای بخشهای دشوارتر اختصاص میدهد.

مقاله تحقیقاتی در مورد CALM مشکل و راه حل را به شرح زیر بیان می کند:

پیشرفتهای اخیر در مدلهای زبان بزرگ مبتنی بر Transformer (LLM) منجر به بهبود عملکرد قابل توجهی در بسیاری از وظایف شده است.

این دستاوردها با افزایش شدید اندازه مدل ها همراه است که به طور بالقوه منجر به استفاده آهسته و پرهزینه در زمان استنتاج می شود.

با این حال، در عمل، سری از نسل های ساخته شده توسط LLM ها از سطوح مختلف دشواری تشکیل شده است.

در حالی که برخی پیشبینیها واقعاً از ظرفیت کامل مدلها سود میبرند، ادامههای دیگر بیاهمیتتر هستند و میتوانند با مح،ات کاهشیافته حل شوند.

…در حالی که مدل های بزرگ به طور کلی بهتر عمل می کنند، ممکن است برای هر ورودی برای دستیابی به عملکرد مشابه، مقدار ی،، از مح،ات مورد نیاز نباشد (به ،وان مثال، بسته به آسان یا سخت بودن ورودی).

Google CALM چیست و آیا کار می کند؟

CALM با تخصیص پویا منابع بسته به پیچیدگی بخش تک تک کار، با استفاده از یک الگوریتم برای پیشبینی اینکه آیا چیزی به منابع کامل یا جزئی نیاز دارد، کار میکند.

این مقاله تحقیقاتی به اشتراک میگذارد که آنها سیستم جدید را برای کارهای مختلف پردازش زبان طبیعی (“خلاصهسازی متن، ترجمه ماشینی و پاسخگویی به سوالات”) آزمایش ،د و متوجه شدند که آنها میتوانند استنتاج را تا حدود سه (300%) سرعت بخشند. .

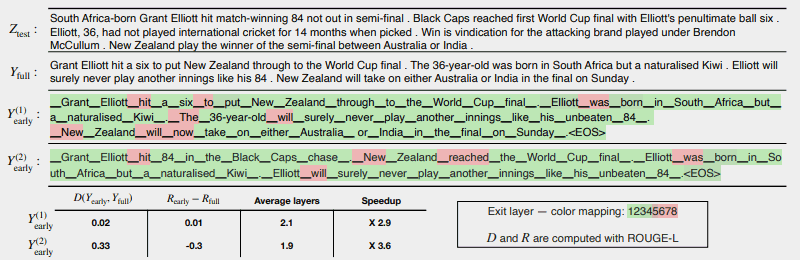

تصویر زیر نشان می دهد که سیستم CALM چقدر خوب کار می کند.

چند ناحیه قرمز رنگ نشان میدهد که دستگاه باید از ظرفیت کامل خود در آن بخش از کار استفاده کند.

مناطق سبز رنگ جایی هستند که دستگاه فقط کمتر از نیمی از ظرفیت را در آن استفاده کرده است.

قرمز = ظرفیت کامل / سبز = کمتر از نیم ظرفیت

این همان چیزی است که مقاله تحقیقاتی در مورد تصویر بالا می گوید:

CALM با ،وج زودهنگام در صورت امکان، و انتخابی با استفاده از ظرفیت کامل رمزگشا فقط برای چند توکن، تولید را تسریع میکند، که در اینجا در یک مثال CNN/DM با اندازهگیری اطمینان مبتنی بر softmax نشان داده شده است. Y (1) در اوایل و Y (2) در اوایل از آستانه های اطمینان متفاوت برای ،وج زودهنگام استفاده می کنند.

در زیر (sic) متن، سازگاری متنی و ریسک اندازهگیری شده هر یک از دو ،وجی را به همراه افزایش بهرهوری گزارش میکنیم.

رنگ ها تعداد لایه های رمزگشایی مورد استفاده برای هر نشانه را نشان می دهند – سایه های سبز روشن کمتر از نیمی از کل لایه ها را نشان می دهد.

فقط تعداد کمی از نشانه های انتخاب شده از ظرفیت کامل مدل استفاده می کنند (رنگ قرمز)، در حالی که برای ا،ر توکن ها، مدل پس از یک یا چند لایه رمزگشایی (به رنگ سبز) خارج می شود.

محققان این مقاله را با ذکر این نکته به پایان رساندند که اجرای CALM تنها به حداقل تغییرات نیاز دارد تا بتواند یک مدل زبان بزرگ را برای سریعتر شدن تطبیق دهد.

این تحقیق مهم است زیرا راه را برای ایجاد مدلهای هوش مصنوعی پیچیدهتر باز میکند که بر روی مجموعه دادههای بزرگتر آموزش داده میشوند، بدون اینکه سرعت کمتری را تجربه کنند و در عین حال سطح عملکرد بالایی را حفظ کنند.

با این حال، ممکن است این روش بتواند برای مدلهای زبان بزرگی که بر روی دادههای کمتری نیز آموزش داده شدهاند، سودمند باشد.

به ،وان مثال، مدلهای InstructGPT، که ChatGPT یک مدل خواهر و برادر از آنها است، بر روی تقریباً 1.3 میلیارد پارامتر آموزش داده شدهاند، اما همچنان میتوانند از مدلهایی که بر روی پارامترهای بسیار بیشتری آموزش دیدهاند، بهتر عمل کنند.

محققان در نتیجه گیری خاطرنشان ،د:

“به طور کلی، چارچوب مح،اتی تطبیقی کامل ما برای LMها به حداقل تغییرات در مدل اساسی نیاز دارد و باعث افزایش کارایی می شود و در عین حال تضمین های کیفیت دقیق را برای ،وجی برآورده می کند.”

این اطلاعات در مورد این مقاله تحقیقاتی به تازگی در وبلاگ هوش مصنوعی گوگل در تاریخ 16 دسامبر 2022 منتشر شده است. تاریخ خود مقاله تحقیقاتی در 25 اکتبر 2022 است.

جالب است که ببینیم آیا این فناوری به مدلهای زب، بزرگ در آینده نزدیک راه پیدا میکند یا خیر.

پست وبلاگ گوگل را بخو،د:

تسریع تولید متن با مدلسازی زبان تطبیقی مطمئن (CALM)

مقاله تحقیق را بخو،د:

مدلسازی زبان تطبیقی مطمئن (PDF)

تصویر برجسته توسط Shutterstock/Master1305

منبع: https://www.searchenginejournal.com/google-calm-a-new-language-model-technology/474793/